خطرات و تهدیدات هوش مصنوعی روزبهروز بیشتر مورد توجه متخصصان و عموم مردم قرار میگیرد. با پیشرفت این فناوری، نگرانیهایی مثل نقض حریم خصوصی، سوءاستفاده از دادهها، انتشار اطلاعات نادرست و حتی ایجاد تهدیدات امنیتی جدیتر شده است. اگر میخواهی بدانی مهمترین خطرات و تهدیدات هوش مصنوعی چیست و چطور میتوان از خودمان در برابر آنها محافظت کنیم، ادامه این مقاله را بخوان.

چرا باید به خطرات هوش مصنوعی توجه کرد؟

پیشرفتهای خیرهکننده هوش مصنوعی در سالهای اخیر، نویدبخش تحولی عظیم در زندگی بشر است. از توسعه چتباتهایی مانند چت جی پی تی گرفته تا تشخیص پزشکی دقیق، هوش مصنوعی در حال تغییر شیوه زندگی و کار ماست. بااینحال در کنار تمام مزایای آن، چالش های هوش مصنوعی را نمیتوان نادیده گرفت. هوش مصنوعی، اگرچه ابزاری قدرتمند است؛ اما در صورت عدم مدیریت صحیح میتواند تهدیدات جدی برای امنیت، حریم خصوصی و حتی بقای بشر ایجاد کند.

ازاینرو، درک عمیق از این خطرات و تدوین راهکارهای مناسب برای مقابله با آنها، امری ضروری و اجتنابناپذیر است. در ادامه به برخی از مهمترین دلایلی که نشان میدهند چرا باید به خطرات هوش مصنوعی توجه جدی داشته باشیم، خواهیم پرداخت.

با پیشرفت تکنیکهای یادگیری ماشین و افزایش قدرت محاسباتی، امکان توسعه سیستمهای هوش مصنوعی قدرتمندی که قادر به انجام اقدامات پیچیده و خودکار هستند، فراهم شده است. این سیستمها میتوانند برای اهدافی مانند حملات سایبری، انتشار اطلاعات نادرست و حتی توسعه سلاحهای خودمختار مورد استفاده قرار بگیرند.

اگر میخواهی در محیطی کاملاً امن و فارسی با هوش مصنوعی تعامل داشته باشی، پلتفرم فارسی هوشا تجربهای متفاوت از گفتگو و دریافت اطلاعات بدون نیاز به ثبتنام یا ارسال اطلاعات حساس فراهم کرده است.

دلیل دوم، تهدیدات علیه حریم خصوصی است. جمعآوری و تحلیل حجم عظیمی از دادهها که یکی از پایههای اصلی توسعه هوش مصنوعی است، میتواند به نقض جدی حریم خصوصی افراد منجر شود. اطلاعات شخصی افراد از جمله دادههای بیومتریک و سوابق پزشکی، میتوانند بدون رضایت آنها جمعآوری و برای اهداف مختلف مورد استفاده قرار بگیرند. این امر، علاوهبر ایجاد نگرانیهای اخلاقی، میتواند به سوءاستفاده از اطلاعات شخصی و ایجاد آسیبهای جدی به افراد منجر شود.

دلیل سوم، احتمال ایجاد نابرابریهای اجتماعی است. گسترش هوش مصنوعی میتواند به افزایش نابرابریهای اجتماعی موجود دامن بزند. اتوماسیون بسیاری از مشاغل و جایگزینی نیروی کار انسانی با ماشینها، میتواند به افزایش بیکاری و کاهش فرصتهای شغلی برای بسیاری از افراد منجر شود. همچنین، دسترسی نابرابر به فناوریهای هوش مصنوعی میتواند شکاف بین ثروتمندان و فقرا را عمیقتر کند.

در نهایت، خطر ازدسترفتن کنترل بر سیستمهای هوش مصنوعی نیز قابلتوجه است. با افزایش پیچیدگی سیستمهای هوش مصنوعی، پیشبینی رفتار آنها و کنترل آنها در همه شرایط دشوار میشود. درصورتیکه یک سیستم هوش مصنوعی از کنترل خارج شود، میتواند تصمیماتی اتخاذ کند که نتایج غیرقابلپیشبینی و مخربی داشته باشد.

درنتیجه، توجه به خطرات هوش مصنوعی و تدوین راهکارهای مناسب برای مدیریت آنها، امری ضروری و حیاتی است. با شناخت دقیق این خطرات و همکاری بینالمللی، میتوان از پتانسیلهای عظیم هوش مصنوعی بهرهمند شد و درعینحال از بروز پیامدهای ناخواسته آن جلوگیری کرد.

هوش مصنوعی Bard چیست؟ بررسی قابلیتها و کاربردها

9 تا از خطرات امنیتی هوش مصنوعی

هوش مصنوعی (AI) بهعنوان یکی از فناوریهای متحولکننده قرن حاضر، پتانسیلهای بسیار بالایی برای بهبود زندگی بشر دارد. بااینحال، همانند هر فناوری قدرتمند دیگری، هوش مصنوعی نیز با خود خطراتی بههمراه میآورد. در این بخش به بررسی مهمترین خطرات امنیتی هوش مصنوعی در بخشهای مختلف اجتماعی، اقتصادی و صنعتی خواهیم پرداخت.

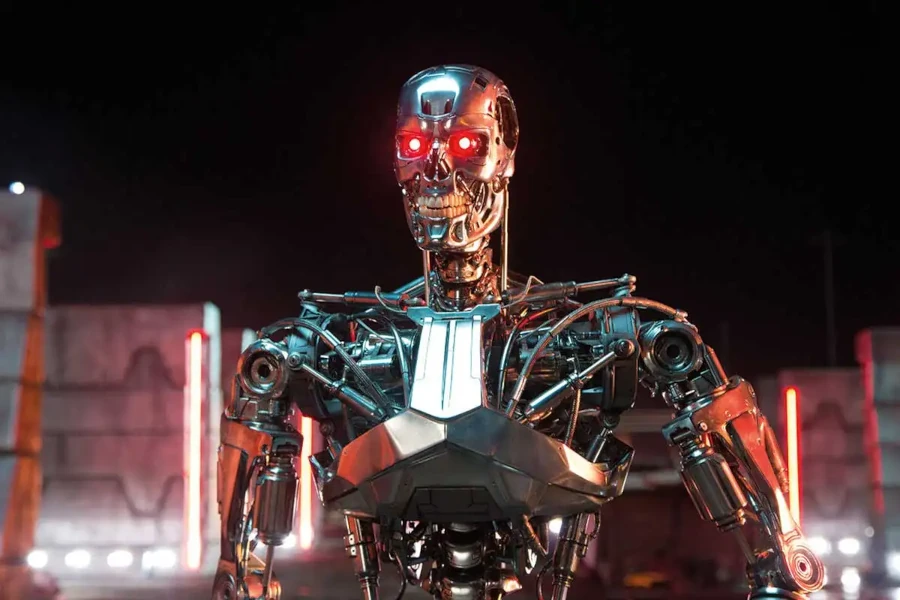

توسعه سلاحهای خودمختار

یکی از نگرانکنندهترین کاربردهای هوش مصنوعی، توسعه سلاحهای خودمختار است. این سلاحها قادرند بدون دخالت مستقیم انسان، اهداف خود را شناسایی و مورد حمله قرار بدهند. خطر اصلی این سلاحها در این است که ممکن است تصمیمات اشتباه بگیرند یا به دست افراد یا گروههای مخرب بیافتند و منجر به فجایع انسانی گسترده شوند.

همچنین، مسابقه تسلیحاتی در زمینه سلاحهای خودمختار میتواند به بیثباتی جهانی و افزایش خطر جنگهای تصادفی منجر شود. علاوهبراین، سؤالات اخلاقی بسیاری در مورد استفاده از سلاحهای خودمختار وجود دارد از جمله اینکه آیا ماشینها باید حق گرفتن جان انسان را داشته باشند یا خیر.

حملات سایبری پیشرفته

خطرات هوش مصنوعی در حوزه امنیت سایبری به یک نگرانی جدی تبدیل شده است. هوش مصنوعی نهتنها فرصتهای جدیدی را برای امنیت سایبری فراهم میکند، بلکه میتواند ابزار قدرتمندی در دست هکرها برای انجام حملات سایبری پیچیده و هدفمند باشد. با استفاده از الگوریتمهای یادگیری ماشین، هکرها میتوانند حملاتی را طراحی کنند که بهسرعت و دقت بالایی قادر به شناسایی نقاط ضعف سیستمهای امنیتی باشند.

این حملات میتوانند بسیار پیچیده و شخصیسازی شده باشند و در برابر روشهای سنتی دفاعی مقاومتر باشند. علاوهبراین، هوش مصنوعی میتواند برای تولید بدافزارهای پیچیده و خودکارسازی فرایندهای حمله مورد استفاده قرار بگیرد. این امر باعث میشود که تشخیص و مقابله با این حملات بسیار دشوارتر شود.

توزیع اطلاعات نادرست و اخبار جعلی

هوش مصنوعی میتواند به ابزاری قدرتمند برای تولید و انتشار گسترده اطلاعات نادرست و اخبار جعلی تبدیل شود. الگوریتمهای هوش مصنوعی قادرند حجم عظیمی از محتوا را با سرعت و دقت بالایی تولید کنند که تشخیص آن از محتوای واقعی بسیار دشوار است. این اطلاعات نادرست میتواند بهسرعت در شبکههای اجتماعی منتشر شده و به شکلگیری افکار عمومی و تصمیمگیریهای مهم تأثیر بگذارد.

ازسویی، رباتها و حسابهای کاربری جعلی که توسط هوش مصنوعی کنترل میشوند، میتوانند بهصورت هماهنگ و هدفمند اخبار جعلی را منتشر کرده و باعث ایجاد آشوب و بیاعتمادی در جامعه شوند. این امر میتواند عواقب جدی برای دموکراسی، انتخابات و روابط بینالملل داشته باشد.

تبعیض و نابرابری

خطرات هوش مصنوعی در زمینه تقویت تبعیض و نابرابری اجتماعی بسیار جدی است. هوش مصنوعی، بهویژه هنگامی که بر روی دادههای تاریخی آموزش ببیند، میتواند تبعیضات و نابرابریهای موجود در جامعه را تقویت کند. در مقایسه هوش مصنوعی و انسان مشخص شده است که الگوریتمهای هوش مصنوعی ممکن است بهطور ناخودآگاه ویژگیهای خاصی را با گروههای خاصی مرتبط کنند و درنتیجه، تصمیماتی اتخاذ کنند که منجر به تبعیض در زمینههای مختلفی مانند استخدام، اعطای وام و حتی سیستم عدالت کیفری شوند.

بهعنوانمثال، اگر یک الگوریتم استخدام بر روی دادههایی آموزش ببیند که در آن افراد از یک گروه خاص کمتر موفق بودهاند، ممکن است بهطور خودکار احتمال موفقیت این گروه را کمتر ارزیابی کند. این امر میتواند به تقویت چرخههای نابرابری و محرومیت از فرصتهای برابر منجر شود.

هوش مصنوعی رایگان هوشا مانند یک دستیار شخصی، برای همفکری روی ایدهها و ارائه پاسخهای استدلالی طراحی شده است. این ابزار با ترکیب چند مدل قدرتمند جهانی، تجربهای هوشمند و تعاملی را در اختیار کاربران قرار میدهد. در ویدیوی زیر این ابزار را معرفی کردهایم:

ازدستدادن شغل

یکی از نگرانیهای اصلی در مورد توسعه هوش مصنوعی، تأثیر آن بر بازار کار است. با پیشرفت روزافزون فناوری هوش مصنوعی و توانایی آن در اتوماسیون بسیاری از وظایف، نگرانیها در مورد ازدستدادن مشاغل توسط انسانها افزایش یافته است. بسیاری از مشاغل تکراری و مبتنی بر دادهها، مانند کار در خط تولید، خدمات مشتری و برخی از مشاغل اداری در معرض خطر اتوماسیون توسط هوش مصنوعی هستند.

این امر میتواند منجر به افزایش بیکاری، کاهش درآمد و نابرابری اقتصادی شود. اگرچه هوش مصنوعی میتواند مشاغل جدیدی را نیز ایجاد کند؛ اما سرعت ایجاد مشاغل جدید ممکن است به اندازه سرعت از بین رفتن مشاغل نباشد.

تهدید حریم خصوصی

یکی از مهمترین خطرات هوش مصنوعی، تهدید جدی برای حریم خصوصی افراد است. هوش مصنوعی با توانایی جمعآوری، تحلیل و پردازش حجم عظیمی از دادهها، میتواند پروفایلهای دقیق و شخصیسازیشدهای از افراد ایجاد کند. این اطلاعات میتوانند برای اهداف مختلفی از جمله تبلیغات هدفمند، دستکاری افکار عمومی و حتی اعمال نفوذ سیاسی مورد استفاده قرار بگیرند. علاوهبراین با گسترش اینترنت اشیاء و جمعآوری دادهها از طریق دستگاههای هوشمند، حریم خصوصی افراد در معرض تهدیدات بیشتری قرار گرفته است.

ایجاد وابستگی بیشازحد

یکی از خطرات کمتر شناخته شده اما مهم هوش مصنوعی، ایجاد وابستگی بیشازحد به آن است. با پیشرفت روزافزون هوش مصنوعی و ورود آن به جنبههای مختلف زندگی از جمله تصمیمگیریهای مهم، ممکن است انسانها بهطور فزایندهای به آن وابسته شوند. این وابستگی میتواند منجر به کاهش تواناییهای شناختی و خلاقیت انسانها شود. همچنین در صورت بروز اختلال در سیستمهای هوش مصنوعی، ممکن است جامعه با مشکلات جدی مواجه شود. علاوهبراین، وابستگی بیشازحد به هوش مصنوعی میتواند به کاهش استقلال فردی و افزایش کنترل سیستمها بر زندگی انسانها منجر شود.

مسائل اخلاقی

خطرات هوش مصنوعی فراتر از مسائل فنی، ابعاد اخلاقی پیچیدهای را نیز در بر میگیرد. تصمیمگیریهای الگوریتمهای هوش مصنوعی، بهویژه در حوزههایی مانند پزشکی و عدالت کیفری، میتواند عواقب اخلاقی جدی داشته باشد. مسائلی مانند مسئولیتپذیری در صورت بروز خطا، تبعیض در تصمیمگیری و استفاده از هوش مصنوعی در جنگافزارها از جمله چالشهای اخلاقی مهمی هستند که نیازمند توجه ویژه هستند. همچنین، مسئله شفافیت در الگوریتمهای هوش مصنوعی و حق دسترسی افراد به اطلاعاتی که در مورد آنها جمعآوری میشود از دیگر مسائل اخلاقی قابلتوجه هستند.

مسئولیتپذیری

یکی از چالشهای اساسی در توسعه و کاربرد هوش مصنوعی، مسئله مسئولیتپذیری است. هنگامی که یک سیستم هوش مصنوعی تصمیمگیری میکند که منجر به عواقب نامطلوب میشود، چه کسی مسئول آن خواهد بود؟ آیا طراح سیستم، سازنده الگوریتم یا خود سیستم هوش مصنوعی مسئول شناخته خواهد شد؟ تعیین مسئولیت در این موارد بسیار پیچیده است؛ زیرا سیستمهای هوش مصنوعی بهطور مداوم در حال یادگیری و تکامل هستند و رفتار آنها ممکن است قابلپیشبینی نباشد. علاوهبراین با افزایش پیچیدگی این سیستمها، ردیابی و ارزیابی تصمیمات آنها نیز دشوارتر میشود.

چالشهای اخلاقی و حقوقی هوش مصنوعی

خطرات هوش مصنوعی در حوزه اخلاق و حقوق بسیار گسترده است. با پیشرفت روزافزون هوش مصنوعی، پرسشهای پیچیدهای در حوزه اخلاق و حقوق مطرح میشود که پاسخدادن به آنها مستلزم تفکر عمیق و همهجانبه است. این چالشها از جنبههای مختلفی قابلبررسی هستند.

- شفافیت: بسیاری از الگوریتمهای هوش مصنوعی بهدلیل پیچیدگی بسیار زیاد، بهعنوان جعبه سیاه عمل میکنند و درک عملکرد آنها دشوار است.

- استفادههای سوء: هوش مصنوعی میتواند برای اهداف مخرب مانند تولید اطلاعات نادرست، دستکاری افکار عمومی یا ایجاد سلاحهای خودمختار مورد استفاده قرار بگیرد.

- مالکیت معنوی: چه کسی مالک خروجیهای خلاقانه یک سیستم هوش مصنوعی است؟

- مسئولیت مدنی: در صورت بروز خسارت ناشی از عملکرد یک سیستم هوشمند، چه کسی باید پاسخگو باشد؟

- حفاظت از دادهها: قوانین موجود برای حفاظت از دادهها ممکن است برای مقابله با چالشهای ناشی از هوش مصنوعی کافی نباشند.

- تنظیمگری: ایجاد قوانین و مقررات مناسب برای نظارت بر توسعه و کاربرد هوش مصنوعی، یک چالش پیچیده است.

- بیکاری: اتوماسیون بسیاری از مشاغل توسط هوش مصنوعی، میتواند منجر به افزایش بیکاری و نابرابری اقتصادی شود.

- تغییرات در روابط اجتماعی: گسترش تعاملات انسان با ماشینها میتواند بر روابط اجتماعی و ساختارهای اجتماعی تأثیر بگذارد.

- مسئولیتپذیری: در صورت بروز خطا یا آسیب ناشی از تصمیمگیری یک سیستم هوشمند، چه کسی مسئول خواهد بود؟ طراح، برنامهنویس یا خود سیستم؟

- تبعیض: الگوریتمهای هوش مصنوعی ممکن است براساس دادههای آموزشی موجود، تبعیضهایی را نسبت به گروههای خاصی از افراد اعمال کنند.

- حریم خصوصی: جمعآوری و تحلیل دادههای شخصی توسط سیستمهای هوشمند، تهدیدی جدی برای حریم خصوصی افراد محسوب میشود.

راهکارها و مدیریت خطرات هوش مصنوعی

با پیشرفت سریع هوش مصنوعی، خطرات هوش مصنوعی نیز به موازات آن افزایش یافته است. بههمیندلیل، مدیریت خطرات و چالشهای ناشی از آن به یکی از مهمترین دغدغههای جوامع جهانی تبدیل شده است. برای مقابله با این چالشها، ترکیبی از اقدامات فنی، قانونی و اجتماعی ضروری است.

از جمله راهکارهای فنی میتوان به موارد زیر اشاره کرد:

- شفافیت الگوریتمها: افزایش شفافیت در نحوه عملکرد الگوریتمها و تصمیمگیریهای سیستمهای هوش مصنوعی، بهمنظور قابلفهمشدن و قابلاعتمادشدن آنها.

- ایمنسازی سیستمها: تقویت امنیت سیستمهای هوش مصنوعی در برابر حملات سایبری و سوء استفادههای احتمالی.

- توسعه الگوریتمهای اخلاقی: طراحی الگوریتمهایی که ارزشهای اخلاقی انسانی را درنظر بگیرند و از رفتارهای تبعیضآمیز و ناعادلانه جلوگیری کنند.

- تست و ارزیابی مداوم: انجام تستهای مستمر و ارزیابیهای دقیق بر روی سیستمهای هوش مصنوعی برای شناسایی و رفع خطاها و نقصها.

راهکارهای قانونی خطرات هوش مصنوعی نیز شامل موارد زیر میشود:

- تدوین قوانین و مقررات جامع: ایجاد قوانین و مقررات مشخص برای نظارت بر توسعه و کاربرد هوش مصنوعی با هدف حافظت از حقوق افراد و جامعه.

- مسئولیتپذیری: تعیین چارچوب مشخصی برای مسئولیتپذیری در صورت بروز خسارت ناشی از عملکرد سیستمهای هوش مصنوعی.

- حفاظت از دادهها: تقویت قوانین حفاظت از دادههای شخصی برای جلوگیری از سوء استفاده از اطلاعات افراد توسط سیستمهای هوش مصنوعی.

- همکاری بینالمللی: ایجاد همکاریهای بینالمللی برای تدوین استانداردهای جهانی در حوزه هوش مصنوعی.

از جمله راهکارهای اجتماعی نیز میتوان به موارد زیر اشاره کرد:

- آموزش و آگاهیرسانی: افزایش آگاهی عمومی در مورد هوش مصنوعی، مزایا و خطرات آن و همچنین آموزش مهارتهای لازم برای زندگی در عصر هوش مصنوعی.

- توسعه اخلاق هوش مصنوعی: تشویق به بحث و گفتوگو در مورد مسائل اخلاقی مرتبط با هوش مصنوعی و تدوین اصول اخلاقی برای توسعه و کاربرد آن.

- مشارکت عمومی: ایجاد فرصت برای مشارکت عمومی در تصمیمگیریهای مربوط به توسعه و کاربرد هوش مصنوعی.

سخن پایانی

هوش مصنوعی بهعنوان یک فناوری نوظهور و پرکاربرد، فرصتهای بینظیری را برای پیشرفت بشر فراهم آورده است. بااینحال، خطرات هوش مصنوعی چالشهای جدی و پیچیدهای بههمراه دارد. از جمله مهمترین این چالشها میتوان به مسائل اخلاقی، حقوقی، اجتماعی و امنیتی اشاره کرد. برای مدیریت مؤثر این خطرات، نیازمند رویکردی چندجانبه هستیم که شامل تدوین قوانین و مقررات جامع، توسعه فناوریهای ایمن و اخلاقی، افزایش آگاهی عمومی و همکاری بینالمللی باشد.

با توجه بهسرعت بالای پیشرفت فناوری هوش مصنوعی، این چالشها بهصورت مداوم در حال تغییر و تحول بوده و نیازمند بازنگری و بهروزرسانی مستمر راهکارها هستند. در نهایت، میتوان گفت که آینده هوش مصنوعی به تلاشهای مشترک همه ذینفعان از جمله دولتها، صنایع، دانشگاهها و جامعه مدنی بستگی دارد.

آیا هوش مصنوعی میتواند آگاه شود؟

درحالحاضر، هیچ مدرک علمی مبنی بر امکان آگاهی در هوش مصنوعی وجود ندارد. هوش مصنوعی فعلی براساس الگوریتمها و دادهها عمل میکند و توانایی درک و احساسات انسانی را ندارد.

چه کشورهایی در زمینه هوش مصنوعی پیشرو هستند؟

کشورهای آمریکا، چین، ژاپن و برخی کشورهای اروپایی در زمینه تحقیق و توسعه هوش مصنوعی پیشرو هستند.

چه صنایعی بیشتر از هوش مصنوعی استفاده میکنند؟

صنایعی مانند فناوری اطلاعات، پزشکی، مالی، خودروسازی و تولید از جمله صنایعی هستند که بیشترین استفاده را از هوش مصنوعی دارند.

آیا هوش مصنوعی میتواند به حل مشکلات جهانی کمک کند؟

بله، هوش مصنوعی پتانسیل بالایی برای حل برخی از مهمترین مشکلات جهانی مانند تغییرات آبوهوایی، بیماریها و فقر دارد. بهعنوانمثال، هوش مصنوعی میتواند در پیشبینی بلایای طبیعی، توسعه داروهای جدید و بهبود مدیریت منابع طبیعی به کار گرفته شود.

آیا ابزار هوش مصنوعی فارسی وجود دارد که حریم خصوصی را رعایت کند؟

چت جی پی تی ایرانی با رعایت الزامات حریم خصوصی و امنیت دادهها برای فارسیزبانان طراحی شده تا بتوانید بدون دغدغه امنیت، از مزایای هوش مصنوعی بهره ببرید.

دانلود چت جی پی تی برای ایفون (آموزش نصب نسخه اصلی و فارسی)

دانلود چت جی پی تی برای ایفون (آموزش نصب نسخه اصلی و فارسی) هوش مصنوعی نانو بنانا Nano Banana: آموزش + نمونه تصاویر

هوش مصنوعی نانو بنانا Nano Banana: آموزش + نمونه تصاویر ربات تغییر چهره تلگرام با هوش مصنوعی: تغییر سن، جنسیت، استایل و…

ربات تغییر چهره تلگرام با هوش مصنوعی: تغییر سن، جنسیت، استایل و… هوش مصنوعی معلم هوشا؛ تدریس خصوصی در خانه + آموزش کار

هوش مصنوعی معلم هوشا؛ تدریس خصوصی در خانه + آموزش کار هوش مصنوعی بدنسازی؛ مربی باشگاه رایگان برای گرفتن برنامه تمرینی و غذایی

هوش مصنوعی بدنسازی؛ مربی باشگاه رایگان برای گرفتن برنامه تمرینی و غذایی